باستخدام واجهة برمجة التطبيقات للتعرّف على الحبر الرقمي ضمن أدوات تعلّم الآلة، يمكنك التعرّف على النصوص المكتوبة بخط اليد وتصنيف الإيماءات على سطح رقمي بمئات اللغات، بالإضافة إلى تصنيف الرسومات. وتستخدم واجهة برمجة التطبيقات الرقمية للتعرّف على الحبر التكنولوجيا نفسها التي تتيح التعرّف على الكتابة بخط اليد في Gboard و"ترجمة Google" ولعبة Quick, Draw!.

وتتيح لك ميزة التعرّف على الحبر الرقمي تنفيذ ما يلي:

- يمكنك الكتابة على الشاشة بدلاً من الكتابة على لوحة مفاتيح افتراضية. ويتيح ذلك للمستخدمين رسم أحرف غير متاحة على لوحة المفاتيح، مثل banana أو اثن أو 森 للوحات المفاتيح الأبجدية اللاتينية.

- تنفيذ العمليات النصية الأساسية (التنقل والتعديل والتحديد وما إلى ذلك) باستخدام الإيماءات.

- يتيح لك هذا الإعداد التعرّف على الأشكال والرموز التعبيرية المرسومة يدويًا.

يعمل نظام التعرّف على الحبر الرقمي بالضغطات التي يرسمها المستخدم على الشاشة. وإذا كنت بحاجة إلى قراءة نص من الصور التي تم التقاطها باستخدام الكاميرا، يمكنك استخدام Text Recognition API.

تعمل ميزة التعرّف على الحبر الرقمي بلا اتصال بالإنترنت بشكل كامل ومتوافق مع نظامَي التشغيل Android وiOS.

الإمكانات الرئيسية

- تحوِّل هذه الدالة النص المكتوب بخط اليد إلى تسلسلات من أحرف يونيكود.

- تشغيل الإضافة على الجهاز في الوقت الفعلي تقريبًا

- تظل الكتابة بخط اليد على الجهاز، ويتم التعرّف عليها بدون أي اتصال بالشبكة.

- التوافق مع أكثر من 300 لغة و25 نظام كتابة، راجِع

القائمة الكاملة للّغات المتوافقة

- توفِّر هذه الميزة تصنيف الإيماءات لهذه اللغات من خلال إضافات

-x-gesture.

- توفِّر هذه الميزة تصنيف الإيماءات لهذه اللغات من خلال إضافات

- يتعرّف على الرموز التعبيرية والأشكال الأساسية

- يعمل على إبقاء مساحة التخزين على الجهاز منخفضة من خلال تنزيل حِزم اللغات بشكل ديناميكي حسب الحاجة

تستخدم أداة التعرُّف عنصر Ink كإدخال. Ink هي تمثيل متجه لما كتبه المستخدم على الشاشة: تسلسل من الضغطات، ويمثل كل منها قائمة من الإحداثيات مع معلومات زمنية تسمى نقاط الاتصال. ويبدأ ضغط المفاتيح

عندما يضع المستخدم قلم الشاشة أو إصبعه وينتهي عندما يرفعه. يتم تمرير Ink إلى أداة التعرّف، والتي تعرض نتيجة واحدة أو أكثر من نتائج التعرّف المحتمَلة بمستويات ثقة.

أمثلة

الكتابة بخط اليد بالإنجليزية

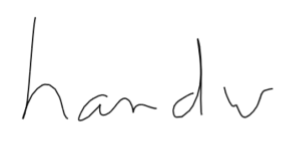

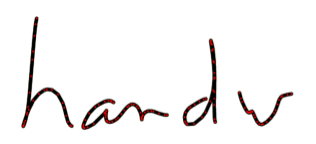

تُظهر الصورة على اليسار أدناه ما رسمه المستخدم على الشاشة. الصورة على اليمين هي كائن Ink المقابل. وهي تحتوي على الخطوط ذات النقاط الحمراء

التي تمثل نقاط الاتصال داخل كل ضربة.

توجد أربع ضغطات. تبدو أول ضغطتين في الكائن Ink على النحو التالي:

| الحبر | ||

|---|---|---|

| شطب 1 | x

|

392، 391، 389، 287، ... |

y

|

52، 60، 76، 97، ... | |

t

|

0، 37، 56، 75، ... | |

| شطب 2 | x

|

497، 494، 493، 490، ... |

y

|

167، 165، 165، 165، ... | |

t

|

694، 742، 751، 770، ... | |

| ... | ||

عند إرسال Ink إلى أداة تعريف باللغة الإنجليزية، يتم عرض العديد من النصوص المحوَّلة من صوت محتمل، وهي تحتوي على خمسة إلى ستة أحرف. يتم ترتيبها عن طريق

تقليل الثقة:

| RecognitionResult | |

|---|---|

| المرشح رقم 1 | ساعة اليد |

| المرشح رقم 2 | هاندرو |

| مرشح التقدير رقم 3 | صلب |

| المرشح رقم 4 | هاندو |

| المرشح رقم 5 | يدويًا |

الإيماءات

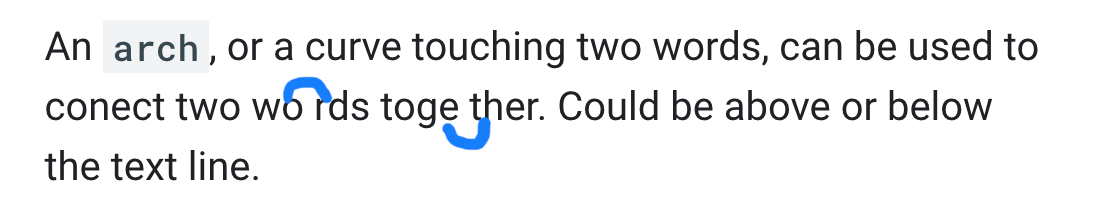

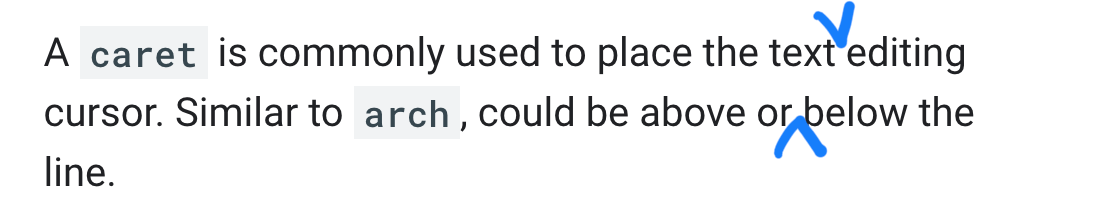

تصنِّف مصنِّفات الإيماءات خط الحبر إلى فئة من فئات الإيماءات التسع الواردة أدناه.

arch:abovearch:below |

|

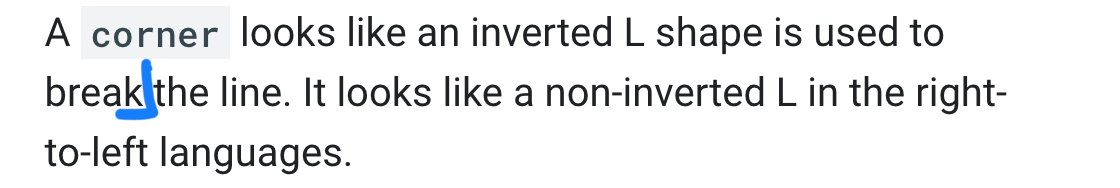

caret:abovecaret:below |

|

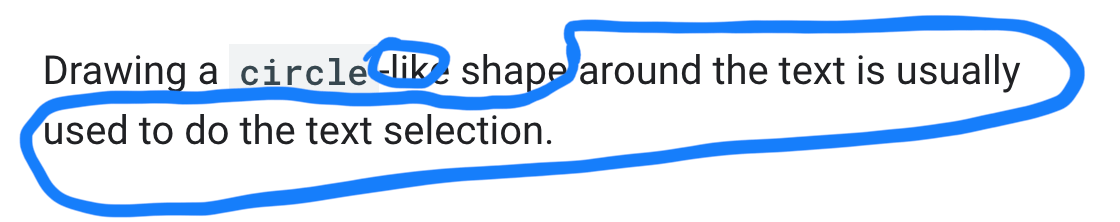

circle |

|

|

|

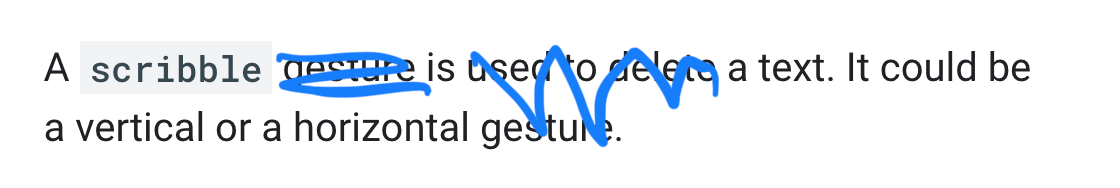

scribble |

|

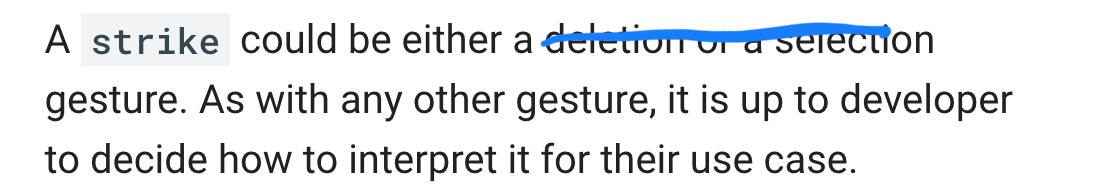

strike |

|

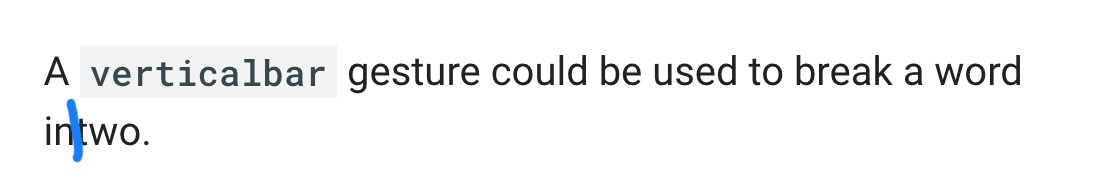

verticalbar |

|

writing |

|

رسومات الرموز التعبيرية

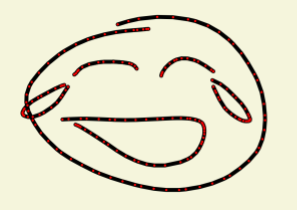

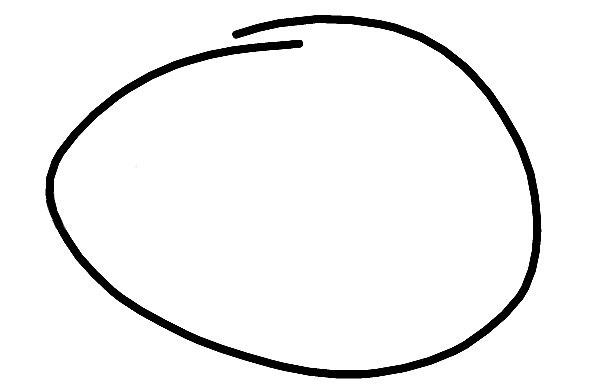

تُظهر الصورة على اليسار أدناه ما رسمه المستخدم على الشاشة. الصورة على اليمين هي كائن Ink المقابل. وهي تحتوي على الخطوط ذات النقاط الحمراء

التي تمثل نقاط الاتصال داخل كل ضربة.

يحتوي الكائن Ink على ست ضغطات.

| الحبر | ||

|---|---|---|

| شطب 1 | x

|

269، 266، 262، 255، ... |

y

|

40، 40، 40، 41، ... | |

t

|

0، 36، 56، 75، ... | |

| شطب 2 | x

|

179، 182، 183، 185، ... |

y

|

157، 158، 159، 160، ... | |

t

|

2475، 2522، 2531، 2541، ... | |

| ... | ||

عند إرسال Ink إلى أداة التعرّف على الرموز التعبيرية، ستحصل على عدة نصوص محتمَلة

مرتبة حسب ترتيب منخفض:

| RecognitionResult | |

|---|---|

| المرشح رقم 1 | 😂 (U+1f62d) |

| المرشح رقم 2 | 😅 (U+1f605) |

| مرشح التقدير رقم 3 | 😹 (U+1f639) |

| المرشح رقم 4 | GR (U+1f604) |

| المرشح رقم 5 | 🔍 (U+1f606) |