Ziel

Im Tutorial zur Adressbestätigung für große Datenmengen wurden verschiedene Szenarien beschrieben, in denen die Adressbestätigung für große Datenmengen verwendet werden kann. In diesem Tutorial stellen wir Ihnen verschiedene Designmuster in der Google Cloud Platform für die Ausführung der Adressbestätigung für große Datenmengen vor.

Zuerst geben wir einen Überblick über die einmalige Ausführung der Adressbestätigung für große Datenmengen in der Google Cloud Platform mit Cloud Run, Compute Engine oder Google Kubernetes Engine. Anschließend sehen wir uns an, wie diese Funktion in eine Datenpipeline eingebunden werden kann.

Am Ende dieses Artikels sollten Sie ein gutes Verständnis der verschiedenen Optionen für die Ausführung der Adressbestätigung für große Datenmengen in Ihrer Google Cloud-Umgebung haben.

Referenzarchitektur in der Google Cloud Platform

In diesem Abschnitt werden verschiedene Designmuster für die Adressbestätigung für große Datenmengen mit der Google Cloud Platform näher erläutert. Wenn Sie die Google Cloud Platform verwenden, können Sie sie in Ihre bestehenden Prozesse und Datenpipelines einbinden.

Einmalige Ausführung der Adressbestätigung für große Datenmengen in der Google Cloud Platform

Unten sehen Sie eine Referenzarchitektur für die Erstellung einer Integration in der Google Cloud Platform, die besser für einmalige Vorgänge oder Tests geeignet ist.

In diesem Fall empfehlen wir, die CSV-Datei in einen Cloud Storage-Bucket hochzuladen. Das Skript für die Adressbestätigung für große Datenmengen kann dann in einer Cloud Run-Umgebung ausgeführt werden. Sie können es aber auch in jeder anderen Laufzeitumgebung wie Compute Engine oder Google Kubernetes Engine ausführen. Die CSV-Ausgabedatei kann auch in den Cloud Storage-Bucket hochgeladen werden.

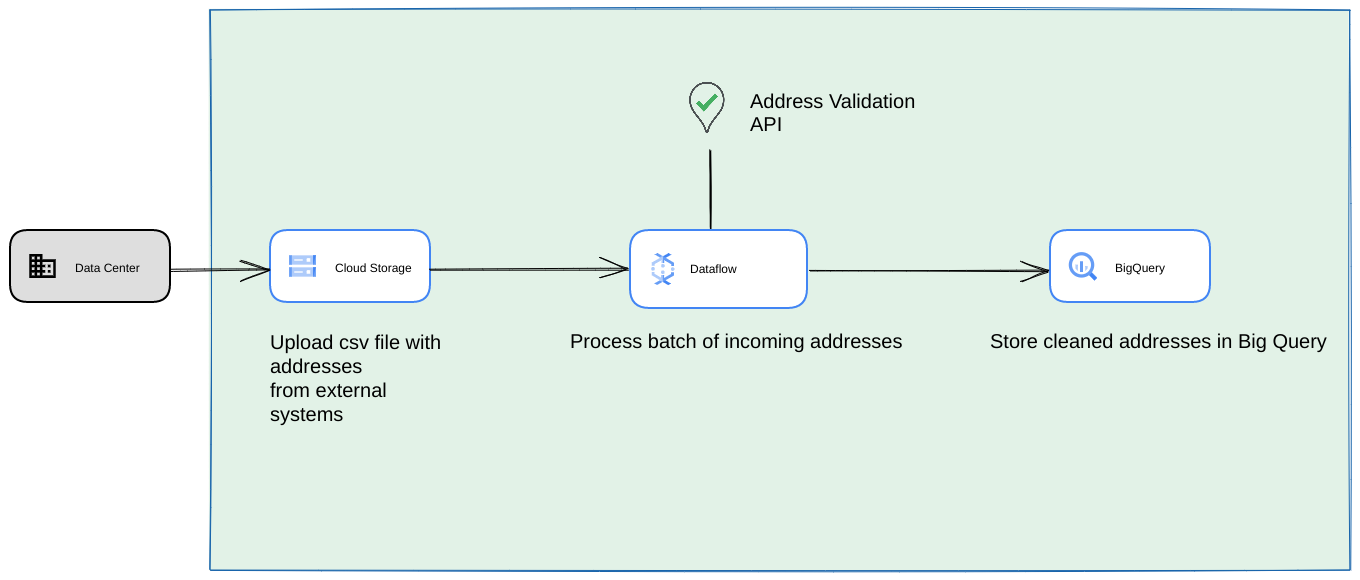

Ausführung als Datenpipeline in der Google Cloud Platform

Das im vorherigen Abschnitt beschriebene Deploymentmuster eignet sich hervorragend, um die Adressbestätigung für große Datenmengen schnell für die einmalige Verwendung zu testen. Wenn Sie sie jedoch regelmäßig als Teil einer Datenpipeline verwenden müssen, können Sie die nativen Funktionen der Google Cloud Platform besser nutzen, um sie robuster zu machen. Einige der Änderungen, die Sie vornehmen können, sind:

- In diesem Fall können Sie CSV-Dateien in Cloud Storage-Buckets ablegen.

- Ein Dataflow-Job kann die zu verarbeitenden Adressen abrufen und dann in BigQuery speichern.

- Die Dataflow-Python-Bibliothek kann um Logik für die Adressbestätigung für große Datenmengen erweitert werden, um die Adressen aus dem Dataflow-Job zu bestätigen.

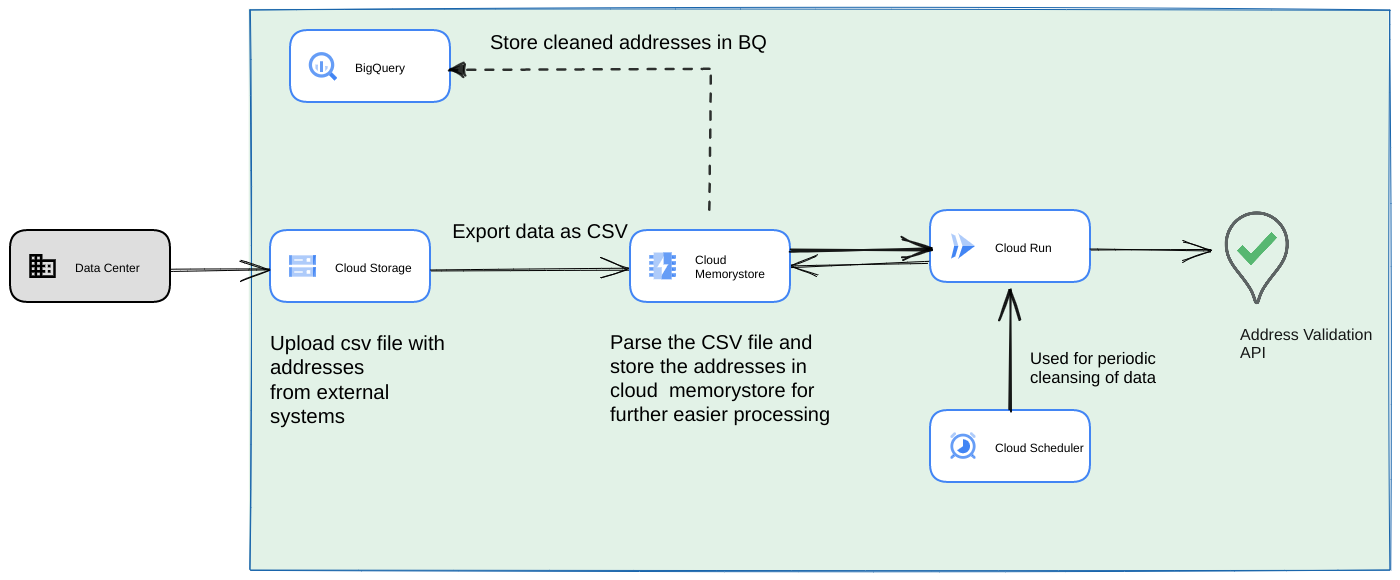

Ausführung des Skripts aus einer Datenpipeline als langfristiger wiederkehrender Prozess

Ein weiterer gängiger Ansatz besteht darin, eine Batch-Adressbestätigung als Teil einer Streaming-Datenpipeline als wiederkehrenden Prozess auszuführen. Möglicherweise befinden sich die Adressen auch in einem BigQuery-Datenspeicher. In diesem Ansatz sehen wir uns an, wie Sie eine wiederkehrende Datenpipeline erstellen, die täglich, wöchentlich oder monatlich ausgelöst werden muss.

- Laden Sie die ursprüngliche CSV-Datei in einen Cloud Storage-Bucket hoch.

- Verwenden Sie Memorystore als persistenten Datenspeicher, um den Zwischenstatus für den lang andauernden Prozess zu verwalten.

- Speichern Sie die endgültigen Adressen in einem BigQuery-Datenspeicher.

- Richten Sie Cloud Scheduler ein, um das Skript regelmäßig auszuführen.

Diese Architektur bietet folgende Vorteile:

- Mit Cloud Scheduler kann die Adressbestätigung regelmäßig durchgeführt werden. Möglicherweise möchten Sie die Adressen monatlich neu bestätigen oder neue Adressen monatlich oder vierteljährlich bestätigen. Diese Architektur hilft bei diesem Anwendungsfall.

Wenn sich Kundendaten in BigQuery befinden, können die bestätigten Adressen oder die Bestätigungs-Flags direkt dort gespeichert werden. Hinweis: Was gespeichert werden kann und wie, wird im Artikel zur Adressbestätigung für große Datenmengen ausführlich beschrieben.

Mit Memorystore sind eine höhere Ausfallsicherheit und die Verarbeitung von mehr Adressen möglich. Mit diesem Schritt wird der gesamten Verarbeitungspipeline ein Status hinzugefügt, der für die Verarbeitung sehr großer Adress-Datasets erforderlich ist. Hier können auch andere Datenbanktechnologien wie Cloud SQL[https://cloud.google.com/sql] oder andere Datenbanken verwendet werden, die die Google Cloud Platform bietet. Wir sind jedoch der Meinung, dass Memorystore die Anforderungen an Skalierung und Einfachheit am besten erfüllt und daher die erste Wahl sein sollte.

Fazit

Wenn Sie die hier beschriebenen Muster anwenden, können Sie die Address Validation API für verschiedene Anwendungsfälle in der Google Cloud Platform verwenden.

Wir haben eine Open-Source-Python-Bibliothek erstellt, um Ihnen den Einstieg in die oben beschriebenen Anwendungsfälle zu erleichtern. Sie kann über die Befehlszeile auf Ihrem Computer oder über die Google Cloud Platform oder andere Cloud-Anbieter aufgerufen werden.

Weitere Informationen zur Verwendung der Bibliothek finden Sie in diesem Artikel.

Nächste Schritte

Laden Sie das Improve checkout, delivery, and operations with reliable addresses Whitepaper (Checkout-, Liefer- und Betriebsprozesse mit zuverlässigen Adressen verbessern) herunter und sehen Sie sich das Improving checkout, delivery, and operations with Address Validation Webinar (Checkout-, Liefer- und Betriebsprozesse mit der Adressbestätigung verbessern) an.

Weitere Lektüre:

- Address Validation API-Dokumentation

- Geocoding und Adressbestätigung

- Address Validation-Demo ansehen

Beitragende

Dieser Artikel wird von Google verwaltet. Die folgenden Beitragenden haben ihn ursprünglich verfasst.

Hauptautoren:

Henrik Valve | Solutions Engineer

Thomas Anglaret | Solutions Engineer

Sarthak Ganguly | Solutions Engineer